-

Plateforme IA native

Plateforme

-

Studio

Plateforme agentique no-code offrant le meilleur time-to-value et le ROI le plus élevé

Découvrir -

Studio

-

Agentic CRM

CRM

-

Agentic CRM

Un CRM nouvelle génération pour gérer les workflows clients et opérationnels

Produits CRM -

Agentic CRM

-

Industries

- Clients

- Partenaires

- A propos

Gouvernance de l’IA - Pourquoi une supervision responsable de l’IA est essentielle

Mis à jour

19 Mars 2026

temps de lecture 18 min

Déployez l’IA en toute sécurité avec Creatio

L’intelligence artificielle transforme la façon dont les organisations fonctionnent, ouvrant la voie à de nouveaux niveaux d’efficacité et d’innovation. Mais ces opportunités s’accompagnent de défis et de questions concernant la confiance, la responsabilité et l’utilisation responsable. C’est là que la gouvernance de l’IA intervient, en fournissant des cadres et des mesures de protection pour garantir que l’IA est équitable, transparente et conforme aux valeurs humaines.

Dans cet article, nous explorons la gouvernance de l’IA, son importance stratégique, les principes qui la structurent, ainsi que les leviers concrets permettant aux entreprises de la mettre en œuvre efficacement.

Points clés à retenir

- La gouvernance de l’IA est essentielle pour instaurer la confiance et favoriser son adoption : elle garantit des systèmes d’IA sûrs, équitables et transparents.

- Des principes fondamentaux guident l’IA responsable : la transparence, la responsabilité et la supervision humaine orientent la gouvernance de l’IA en parallèle des réglementations régionales et spécifiques à chaque industrie.

- La gouvernance crée de la valeur pour l’entreprise : elle renforce la confiance des clients, favorise l’innovation et soutient la compétitivité sur le long terme.

- La mise en œuvre est pratique et réalisable : avec des processus adaptés, les organisations peuvent intégrer la gouvernance dans leurs opérations quotidiennes.

Qu’est-ce que la gouvernance de l’IA ?

La gouvernance de l’IA est un ensemble de règles, de politiques, de processus et de pratiques qui encadrent le développement, le déploiement et la supervision responsables des systèmes d’intelligence artificielle. Elle garantit que les technologies d’IA sont conçues et utilisées de façon éthique et transparente, en adéquation avec les valeurs humaines.

Les pratiques de gouvernance de l’IA répondent spécifiquement aux défis propres à l’IA : le risque de biais et d’hallucinations, les enjeux de confidentialité des données et le manque d’explicabilité des décisions. Un cadre de gouvernance de l’IA complet inclut généralement :

- Considérations et normes éthiques : lignes directrices telles que l’équité, la transparence et le respect des droits humains.

- Processus de gestion des risques : identifier et atténuer les risques tels que les biais et la désinformation.

- Structures de responsabilité : désigner qui assume la responsabilité des décisions prises par l’IA, au sein de l’organisation ou au niveau réglementaire.

- Mécanismes de conformité : garantir le respect des lois, réglementations et normes du secteur liées à l’IA.

Pourquoi la gouvernance de l’IA est-elle importante ?

Avec les limites et imperfections actuelles des modèles d’IA, il est indispensable de ne pas les laisser fonctionner sans encadrement. Malgré son potentiel immense, l’IA n’est pas sans défaut. Cependant, selon une étude d’EY, l’adoption de l’IA est nettement plus avancée que sa gouvernance, avec plus de 75 % des dirigeants interrogés utilisant l’IA générative, mais seulement un tiers disposant de cadres de gouvernance établis. Cette situation n’est pas idéale, car une IA non encadrée peut amplifier les biais existants, produire des résultats trompeurs ou nuisibles, et fonctionner de manière opaque, même pour ses concepteurs.

Sans mécanismes de surveillance structurés, les risques d’effets inattendus et parfois dommageables augmentent considérablement. Air Canada en a fait l’expérience lorsqu’elle a dû régler un litige avec un client devant les tribunaux après que son chatbot alimenté par l’IA ait communiqué des informations erronées.

Voici pourquoi une gouvernance responsable de l’IA est si importante :

Protéger les individus et la société

Une gouvernance insuffisante de l’IA peut entraîner des discriminations, des atteintes à la vie privée ou des décisions néfastes qui touchent les groupes les plus vulnérables. Par exemple, dans le secteur financier, les modèles d’IA utilisés pour l’évaluation du crédit ou l’octroi de prêts ont parfois reproduit des biais historiques. Cela signifie que des demandeurs de prêts issus de certains quartiers ou groupes démographiques peuvent être injustement refusés, même s’ils répondent aux critères financiers.

La gouvernance de l’IA contribue à prévenir ces situations en imposant des audits réguliers, des tests de biais et une responsabilité claire. Avec les bonnes protections, les organisations peuvent s’assurer qu’elles protègent les droits et la sécurité des personnes.

Créer la confiance et favoriser l’adoption

Bien que l’IA soit rapidement adoptée, beaucoup de personnes restent réticentes. Selon l’étude de KPMG, plus de 60 % des personnes utilisent régulièrement l’IA mais moins de la moitié lui font confiance.

Cet écart est souvent qualifié d’anxiété liée à l’IA, une incertitude et une peur face à un système perçu comme une « boîte noire ». La plupart des utilisateurs ne comprennent pas pleinement comment les modèles d’IA prennent des décisions, et ce manque de transparence alimente leur hésitation.

Une solide gouvernance permet de réduire cet écart. En rendant les systèmes d’IA plus transparents, en expliquant la prise de décision et en appliquant des mesures de responsabilité, les organisations peuvent rassurer et renforcer la confiance. Il n’est pas nécessaire que les utilisateurs comprennent tous les aspects techniques, mais ils doivent avoir l’assurance que l’IA est utilisée de manière responsable, équitable et avec les protections adéquates.

Gérer les risques et la conformité

Les gouvernements du monde entier commencent à instaurer de nouvelles règles et normes pour l’IA, comme l’AI Act de l’UE ou les États-Unis. Charte des droits en matière d’IA Si les entreprises ne mettent pas en place une gouvernance appropriée, elles risquent de prendre du retard ou d’être frappées par des amendes élevées - jusqu’à 7 % du chiffre d’affaires annuel mondial dans l’UE ! Un solide cadre de gouvernance de l’IA aide les organisations à respecter les réglementations, à éviter les risques inutiles et à rester prêtes face à de nouvelles lois éventuelles.

L’état des agents d’IA et du no-code

Découvrez comment plus de 560 leaders à travers le monde utilisent les agents IA et le no-code pour stimuler l’innovation dès aujourd’hui

Principes clés de la gouvernance de l’IA

Une gouvernance responsable de l’IA repose sur un ensemble de principes de base qui garantissent que l’intelligence artificielle est développée et appliquée de façon responsable. Même si les cadres spécifiques diffèrent selon les régions et les organisations, la plupart des approches convergent autour de quelques principes essentiels :

1. Transparence

Les systèmes d’IA doivent être compréhensibles pour les utilisateurs, les parties prenantes et les régulateurs. La transparence implique de documenter comment les modèles sont entraînés, quelles données sont utilisées et la logique de leurs résultats. Les utilisateurs doivent pouvoir facilement accéder aux informations sur les chemins de décision et la logique afin d’évaluer comment l’IA est parvenue à ses conclusions et si celles-ci sont justifiées.

2. Équité

Les questions de biais et d’équité sont parmi les plus critiques pour les entreprises utilisant l’IA. Garantir l’équité consiste à faire en sorte que l’IA ne discrimine pas sur la base de la race, du genre, de l’âge ou d’autres caractéristiques protégées, et favorise des résultats équitables pour diverses populations.

La gouvernance de l’IA prévoit des mesures proactives pour identifier, limiter et surveiller les biais injustes dans les algorithmes.

3. Responsabilité

Des responsabilités clairement définies sont essentielles, surtout lorsqu’un problème survient. Les organisations doivent désigner qui est responsable de la conception, du déploiement et des conséquences des systèmes d’IA afin d’éviter la dilution des responsabilités et les retards dans la prise de décision.

Les mécanismes de responsabilité incluent aussi les pistes d’audit, les processus de surveillance et la possibilité d’intervention ou d’arrêt des systèmes si nécessaire.

4. Confidentialité et protection des données

Comme l’IA dépend de grandes quantités de données d’entreprise et personnelles pour fonctionner, la protection des informations sensibles est primordiale. Les cadres de gouvernance garantissent la conformité aux lois sur la protection des données, limitent la collecte de données inutile, empêchent le partage de données propriétaires et utilisent des techniques comme l’anonymisation pour préserver la confidentialité.

5. Sécurité et sûreté

Les systèmes d’IA doivent également être protégés contre les attaques malveillantes. Sans mesures de sécurité appropriées, ils peuvent devenir la cible de violations de données, de tentatives de piratage ou d’accès non autorisé.

L’utilisation responsable de l’IA impose des mesures de sécurité robustes, telles que le chiffrement multicouche, la gestion des accès par rôles et la surveillance continue, pour garantir la protection des systèmes contre des menaces évolutives.

6. Supervision humaine

Au final, les décisions critiques doivent rester entre les mains des humains. La gouvernance met en avant l’idée de garder l’humain au centre, signifiant que l’IA doit compléter les capacités humaines, sans les remplacer, surtout en matière de décisions stratégiques.

At Creatio, we believe the future of automation lies in humans and AI working side by side. Our approach ensures that every AI decision is guided by human oversight, backed by governance, and uncompromising data security.

Concrètement, cela permet de garantir l’implication humaine sur les étapes clés d’un processus, permettant de vérifier, décider ou intervenir quand cela est crucial.

Normes de gouvernance de l’IA

La gouvernance de l’IA est structurée par un ensemble croissant de normes internationales et sectorielles, réglementations et bonnes pratiques. Ces normes définissent les critères pour concevoir, déployer et surveiller l’IA de manière responsable.

Bien qu’elles varient selon les régions et les industries, plusieurs catégories essentielles se distinguent :

1. Réglementations IA mondiales et régionales

À ce jour, il n’existe pas de cadre global unique pour la gouvernance de l’IA ; cependant, de nombreux gouvernements adoptent activement des législations visant à garantir l’utilisation responsable de l’IA dans leur région. L’ AI Act de l’UE, par exemple, classe les systèmes d’IA selon leur niveau de risque et impose des exigences strictes sur les applications à haut risque au sein de l’UE.

Aux États-Unis, bien qu’aucune loi nationale n’existe à ce jour, des initiatives telles que l’AI Bill of Rights apportent des principes d’équité et de responsabilité, et certains états, dont la Californie, renforcent déjà les règles liées à l’IA.

D’autres pays, comme le Canada (AIDA), Singapour (National AI Strategy) et la Corée du Sud (Basic Act), ont également introduit leurs propres cadres, montrant une évolution globale vers un contrôle renforcé.

2. Normes spécifiques à chaque industrie

Au-delà des règles générales, de nombreuses industries doivent se conformer à des réglementations liées à l’IA conçues spécialement pour elles :

- Santé (HIPAA aux États-Unis) : les hôpitaux utilisant l’IA pour le diagnostic doivent garantir l’anonymisation et la sécurité des données patient. Par exemple, un modèle d’IA analysant des IRM ne peut conserver de données identifiables en dehors des systèmes conformes à HIPAA.

- Finance (FINRA, Bâle III) : les banques adoptant l’IA pour détecter la fraude ou évaluer le crédit doivent respecter les normes de transparence et de gestion des risques. Une banque utilisant l’apprentissage automatique pour accorder une hypothèque doit démontrer que son système ne discrimine pas involontairement sur la base des codes postaux ou des critères démographiques.

- Protection des données (RGPD dans l’UE, CCPA en Californie) : un distributeur utilisant des chatbots propulsés par l’IA doit garantir la sécurité des données clients et informer clairement sur toute collecte de données personnelles. Les clients doivent également avoir la possibilité explicite de refuser ou demander la suppression de leurs données.

3. Normes intergouvernementales et directives éthiques

Des organismes internationaux influencent également la gouvernance via des normes volontaires mais déterminantes qui fournissent un cadre global aux décideurs politiques et aux développeurs d’IA.

Les Principes de l’OCDE sur l’IA et la Recommandation UNESCO sur l’éthique de l’IA mettent l’accent sur des valeurs telles que la transparence, l’équité, la responsabilité et le respect des droits humains. Ils plaident pour un écosystème d’IA centré sur l’humain, respectueux des valeurs démocratiques et des droits humains, et qui favorise une croissance inclusive et un développement durable.

Sur le plan technique, le comité ISO/IEC JTC 1/SC 42 travaille à l’élaboration de normes mondiales pour la qualité, la fiabilité et la gestion des risques liés à l’IA. De nombreuses entreprises les adoptent volontairement afin de montrer leur sens des responsabilités et de se préparer aux futures réglementations.

4. Meilleures pratiques organisationnelles

Enfin, une bonne gouvernance ne se limite pas aux réglementations imposées par le sommet. De nombreuses organisations mettent en place leurs propres comités d’éthique de l’IA ou équipes IA responsables pour évaluer les nouveaux projets.

Par exemple, Google a publié ses Principes d’IA pour guider un développement responsable de l’intelligence artificielle.

Nous pensons que notre approche de l’IA doit être à la fois audacieuse et responsable. Audacieuse par son innovation rapide et le déploiement d’IA dans des produits révolutionnaires utilisés par et au bénéfice de tous [...] et responsable par le développement et le déploiement d’une IA qui répond à la fois aux besoins des utilisateurs et à des responsabilités plus larges, tout en protégeant la sécurité, la vie privée et la sûreté des utilisateurs. - Principes d’IA de Google

À une échelle plus réduite, les start-up adoptent souvent des protocoles de test des biais ou des audits indépendants pour rassurer les investisseurs et les clients sur la fiabilité de leurs outils d’IA.

Principaux avantages métier de la mise en œuvre d’une gouvernance de l’IA

La gouvernance de l’IA ne se limite pas à la conformité légale – c’est aussi une stratégie commerciale avisée. En mettant en place les bonnes limites, les organisations peuvent réduire les risques, renforcer la confiance des clients et protéger leur réputation.

Voici ce que les organisations peuvent accomplir avec une bonne politique de gouvernance de l’IA :

- Améliorer la fiabilité des résultats de l’IA : la gouvernance de l’IA améliore les résultats générés par l’intelligence artificielle en favorisant l’utilisation de données solides, impartiales et de haute qualité.

- Réduire les risques de non-conformité : en établissant des lignes directrices et des normes claires qui alignent les systèmes d’IA sur les exigences légales et réglementaires, les organisations assurent leur conformité et évitent des pénalités coûteuses.

- Garantir l’explicabilité : des systèmes d’IA transparents permettent de comprendre comment les décisions sont prises, ce qui facilite leur évaluation et leur mise en œuvre.

- Favoriser une collaboration sécurisée : la gouvernance de l’IA définit des protocoles clairs pour l’utilisation des données et de l’intelligence artificielle dans l’organisation.

- Renforcer la confiance des parties prenantes : la gouvernance de l’IA permet de réduire les craintes et incertitudes liées au déploiement de l’intelligence artificielle. Cela permet de développer les projets d’IA efficacement et d’accélérer leur adoption à l’échelle de l’organisation.

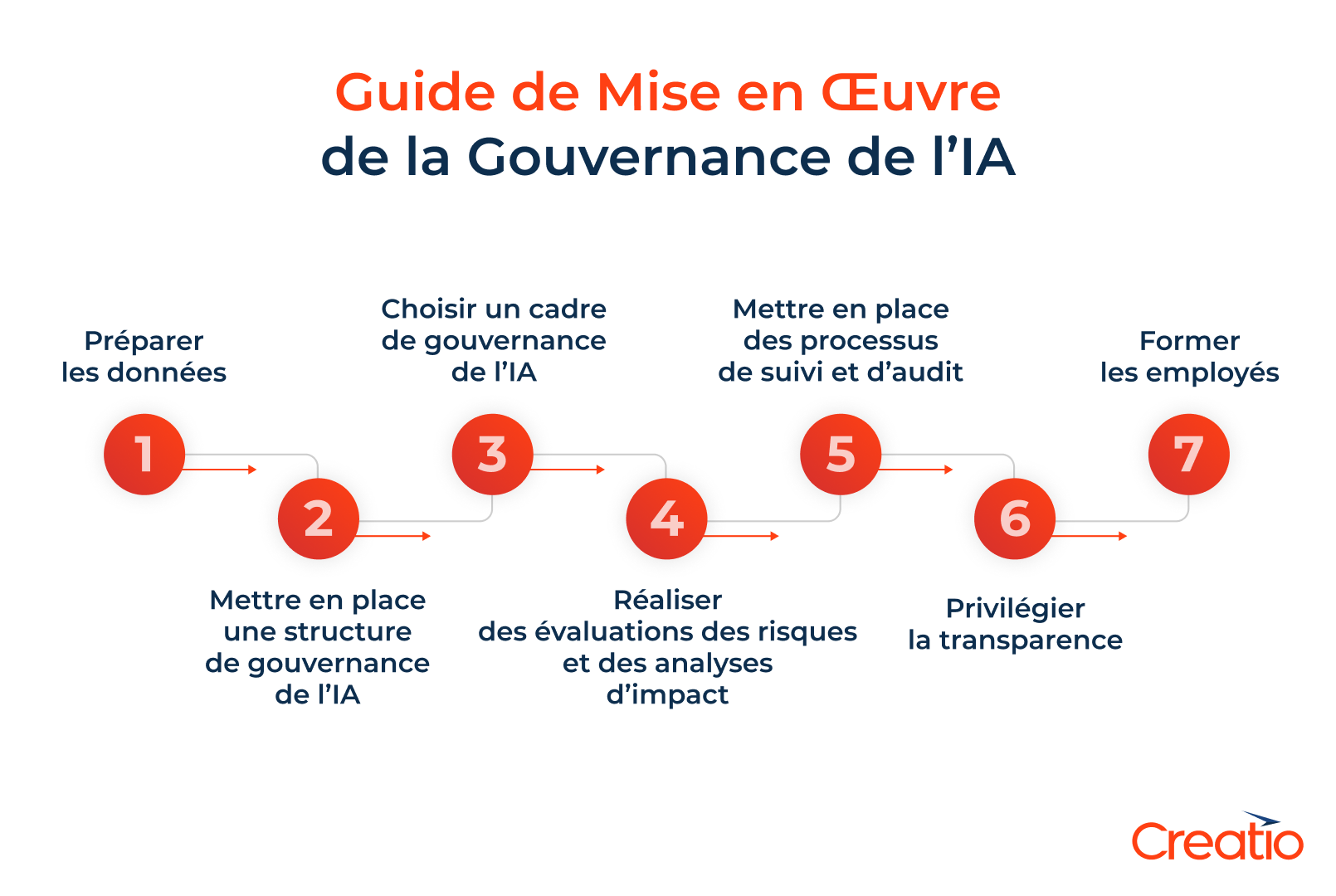

Comment les entreprises peuvent mettre en œuvre la gouvernance de l’IA en pratique

Avoir des principes et des normes est une chose, les appliquer concrètement en est une autre. Pour les organisations, une gouvernance efficace de l’IA consiste à créer des structures, des processus et des responsabilités clairs pour encadrer la conception, le déploiement et le suivi de l’intelligence artificielle dans le temps.

1. Commencer par la préparation des données

Les données sont le moteur de tout système d’IA, et une gouvernance appropriée commence par là. Les entreprises doivent s’assurer que les données alimentant leurs modèles sont précises, représentatives et collectées légalement. Cela implique de nettoyer et de normaliser les jeux de données, de documenter leurs sources et de vérifier l’absence de biais cachés qui pourraient fausser les résultats.

2. Mettre en place des structures de gouvernance de l’IA

Les organisations pionnières dans l’adoption de l’IA optent pour une approche centralisée en créant des centres d’excellence en IA (AI COE) pour piloter la prise de décision. L’AI COE rassemble des responsables des services juridiques, conformité, technologie et métiers pour évaluer les risques et garantir que les projets d’IA sont en phase avec les valeurs de l’entreprise.

3. Choisir un cadre de gouvernance de l’IA

Comme mentionné précédemment, il n’existe pas un cadre, une ligne directrice ou une loi unique applicable à toutes les organisations impliquées dans le développement ou le déploiement d’IA. Comme la réglementation varie selon les pays, régions et secteurs, les entreprises doivent choisir le cadre de gouvernance de l’IA le mieux adapté à leurs besoins et à leur stratégie globale de conformité et de gestion des risques.

Le bon modèle de gouvernance doit non seulement répondre aux exigences légales, mais aussi refléter les valeurs de l’entreprise, les normes sectorielles et l’engagement envers une IA responsable.

4. Réaliser des évaluations des risques et des analyses d’impact

Avant de déployer l’IA, les organisations doivent évaluer les risques potentiels : biais, failles de sécurité, exposition juridique ou atteinte à la réputation. Des outils tels que les analyses d’impact IA gagnent en popularité, notamment dans des régions comme l’UE.

En parallèle, il est important de conserver une certaine flexibilité et d’utiliser la classification et le classement des risques en temps réel. Cette approche leur permet d’appliquer des contrôles plus stricts là où les risques sont les plus élevés (comme les informations personnelles identifiables, les données de santé protégées, les actions autonomes) et des contrôles plus souples là où la rapidité d’innovation est déterminante.

5. Mettre en place des processus de suivi et d’audit

La surveillance continue permet de détecter des problèmes comme la dérive des modèles, la réapparition de biais ou des résultats inattendus.

Pour assurer un suivi et un audit efficaces, les organisations doivent mettre en œuvre :

- Tableaux de bord avec mises à jour en temps réel

- Indicateurs de gouvernance intuitifs

- Systèmes de détection automatisés

- Alertes de performance

- Journaux exhaustifs et pistes d’audit

Les organisations peuvent s’appuyer sur des agents d’IA de gouvernance pour simplifier encore davantage la surveillance et l’audit. Ces agents suivent de manière autonome l’évolution des risques, des changements réglementaires et la performance des systèmes. Ils peuvent automatiquement détecter les problèmes, déclencher des alertes et recommander des contrôles pour garantir la conformité et la sécurité des opérations.

6. Privilégier la transparence

La transparence ne signifie pas exposer chaque ligne de code — mais suppose de documenter le fonctionnement des systèmes d’IA, les données utilisées et les dispositifs de sécurité mis en place.

Les organisations doivent expliquer le fonctionnement de leurs systèmes d’IA en termes clairs aux régulateurs, clients et employés. Cela permet de réduire l’inquiétude et de renforcer la confiance dans la technologie.

7. Former les employés

Une gouvernance efficace de l’IA exige la sensibilisation de toute l’organisation, pas seulement des politiques couchées sur du papier. Former les employés aux pratiques responsables en matière d’IA permet de prévenir les usages abusifs, de réduire les risques et de renforcer la confiance dans la technologie.

Cette formation ne doit pas se limiter aux équipes techniques. Les utilisateurs métier, managers et dirigeants doivent comprendre le fonctionnement de l’IA, ses limitations, et savoir quand l’intervention humaine est essentielle pour garantir une gouvernance active.

Gouvernance IA Creatio

Creatio adopte une approche globale de la gouvernance de l’IA pour permettre aux organisations de bénéficier de l’automatisation pilotée par l’intelligence artificielle sans compromettre la sécurité, la conformité ou le contrôle. Le cœur de cette approche repose sur une architecture IA sécurisée et flexible conçue autour de la transparence, de la responsabilité et d’une protection stricte des données.

Dans la plateforme agentique de Creatio, la sécurité est intégrée dès la conception. Les agents d’IA appliquent un modèle de sécurité zéro confiance et un contrôle d’accès basé sur les rôles (RBAC), garantissant que les données confidentielles ne soient jamais communiquées à des utilisateurs non autorisés. Creatio est également entièrement conforme aux réglementations mondiales sur la protection des données, y compris le RGPD, les réglementations PII et les normes de sécurité d’entreprise. Les pistes d’audit et les contrôles d’IA basés sur des règles fournissent un niveau supplémentaire de supervision, permettant aux entreprises de définir des règles de comportement pour l’IA, d’imposer des restrictions et de tenir des rapports de conformité détaillés pour maintenir l’alignement réglementaire.

Le modèle de gouvernance de Creatio souligne également l’importance de la supervision humaine. Les agents d’IA sont conçus pour assister les personnes plutôt que les remplacer, adoptant une démarche « l’humain dans la boucle » pour s’assurer que les décisions critiques restent entre des mains humaines. Pour soutenir cette approche, Creatio garantit que les décisions de l’IA soient transparentes, équitables et explicables, aidant les utilisateurs à comprendre comment l’IA aboutit à ses conclusions avec une visibilité complète sur la logique, les sources de données et le raisonnement de l’IA.

Les solides pratiques de gouvernance de l’IA de Creatio permettent aux organisations de tirer parti du potentiel de l’intelligence artificielle tout en garantissant qu’elle reste sûre, responsable et en adéquation avec les valeurs organisationnelles et les exigences réglementaires.

Gouverner l’IA pour un avenir responsable

L’intelligence artificielle s’intègre désormais dans notre travail, nos décisions et notre quotidien. Mais avec sa montée en puissance vient une responsabilité tout aussi croissante. Une IA mal gérée peut entraîner biais, violations de la vie privée et conséquences néfastes, tandis qu’une IA bien gouvernée permet d’instaurer la confiance, d’encourager l’innovation et de générer d’importants bénéfices sociaux et économiques.

Une gouvernance responsable de l’IA va au-delà du respect des lois et des normes sectorielles : il s’agit d’instaurer la confiance. En mettant en place des garde-fous, en maintenant la transparence et en gardant l’humain au cœur de la prise de décision, les organisations peuvent transformer la peur et l’incertitude en confiance et en adoption généralisée.

Avec les bons systèmes d’IA, comme Creatio, la gouvernance devient simple. Notre plateforme est conçue autour de la sécurité, de la conformité et de la confiance, gérant la complexité de la gouvernance pour que les entreprises puissent se concentrer sur l’innovation et la croissance.